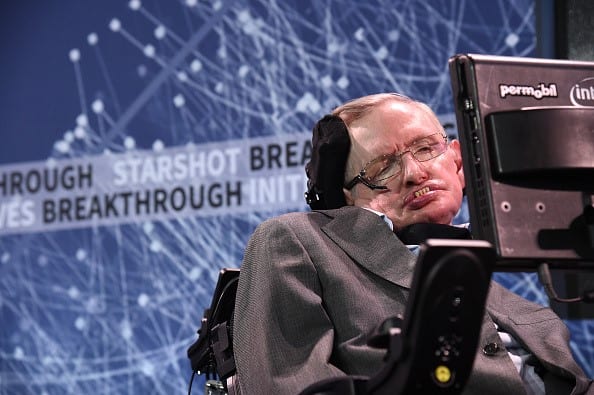

Reddit, una plataforma interactiva en donde se puede agregar información como noticias o encuestas y que al mismo tiempo permite votar positiva o negativamente el contenido para que tenga relevancia, fue el salón para una ‘clase’ de Hawking hace dos años, como destaca Mashable.

En ese momento, el físico dijo que su canción favorita era ‘Have I Told You Lately’, de Rod Stewart; que su película favorita era ‘Jules et Jim’; y que lo último que vio que lo hizo reír fue ‘The Big Bang Theory’. (Vea también: Esta fue la última predicción que hizo Stephen Hawking)

Estas son algunas de las preguntas que respondió en dicho momento:

Evolución de la Inteligencia Artificial

Pregunta: Hola, profesor Hawking, ¡gracias por hacer esto! He pensado últimamente sobre el deseo de los organismos biológicos para sobrevivir y reproducirse y en cómo esas ganas evolucionaron durante millones de generaciones. ¿Tendría la inteligencia artificial estos instintos básicos, y si no, serían una amenaza para la raza humana? También, ¿Cuáles dos libros cree que toda persona debería tener?

Respuesta: Una inteligencia artificial que ha sido diseñada, en vez de evolucionar, puede en principio tener cualquier deseo o motivación. Sin embargo, como señaló Steve Omohundro, una inteligencia artificial extremadamente inteligente en el futuro probablemente podría desarrollar un instinto para sobrevivir y adquirir más recursos como un paso para lograr cualquier meta que se proponga. Porque sobrevivir y tener más recursos incrementaría sus posibilidades de cumplir otra meta. Esto podría traerles problemas a los humanos a los que se les quitaron sus recursos.

También te puede interesar

Desempleo tecnológico

Pregunta: ¿Ha pensado en la posibilidad de un desempleo tecnológico en donde desarrollemos procesos automatizados que eventualmente causen un gran desempleo al hacer trabajos de manera más rápida o más barata de lo que las personas pueden hacerlo?…¿predice un mundo en donde la gente trabaje menos porque hay mucho trabajo automatizado? ¿Cree que la gente siempre va a encontrar trabajo o inventarse más trabajos que hacer? Gracias por su tiempo y sus contribuciones. He encontrado que las investigaciones son un emprendimiento social y que usted ha sido una inspiración para muchos.

Respuesta: Si las máquinas producen todo lo que necesitamos, el resultado dependerá en cómo estén distribuidas las cosas. Todo el mundo puede disfrutar una vida ociosa y lujosa si la riqueza generada por las máquinas es compartida. Si no, la mayoría de las personas pueden terminar miserablemente pobres si los dueños de las máquinas se oponen exitosamente ante la redistribución de la riqueza. Hasta ahora, la tendencia se está yendo por la segunda opción, con la tecnología moviéndose hacia una siempre creciente inequidad.

Posibilidad que la inteligencia artificial supere la inteligencia humana

Pregunta: Hola profesor Hawking, ¡gracias por hacer esto! A principios del año usted, Elon Musk y otros miembros de la ciencia firmaron una carta que alertaba a la sociedad sobre los potenciales peligros de la inteligencia artificial. La carta decía: “Recomendamos investigaciones enfocadas en asegurar que los sistemas crecientes de inteligencia artificial sean robustos y beneficiosos.”…Mis preguntas son: 1. Uno puede creer que es imposible que una criatura adquiera un nivel superior de inteligencia a la de su creador. ¿Está de acuerdo? Si es así, ¿sería la inteligencia artificial una amenaza? 2. ¿Es posible que la inteligencia artificial supere a la humana? ¿Dónde trazaría la línea que dice”suficiente”? ¿Qué tanto los humanos pueden volver inteligente a la inteligencia artificial sin que supere la humana?

Respuesta: Es claramente una posibilidad que algo adquiera una inteligencia superior que la de sus antecesores: evolucionamos para ser más inteligentes que nuestros ancestros de tipo primate, así como Einstein fue más inteligente que sus padres. La línea a la que haces referencia es en donde la IA se convierte mejor para diseñar IA que los mismos humanos, cuando pueda recursivamente mejorarse a ella misma sin la necesidad de ayuda humana. Si esto sucede, podríamos enfrentarnos a una explosión inteligente que eventualmente resulte en máquinas cuya inteligencia supere a la nuestra por mucho más que lo que la nuestra supera a la de los caracoles.

LO ÚLTIMO

.svg)